傲世皇朝资讯

Bilevel Optimization(二阶层优化) 包含了两个阶层的优化任务,一个优化问题嵌套在另一个优化问题内。外层的优化问题通常称为 leader's (upper level) optimization problem,内层的优化问题通常称为 follower's (or lower level) optimization problem。二阶层优化可在一定程度上看作是一个有约束优化问题,因为下层优化问题可看作是上层优化问题的约束。

这类问题中有两类优化变量:leader's (upper level) decision vectors and follower's (lower level) decision vectors。

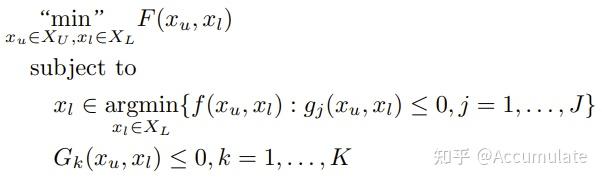

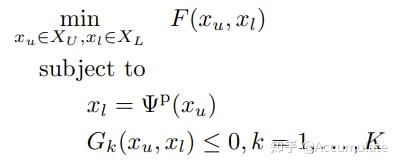

一个标准的二阶层优化问题如下所示:

Bilevel Optimization 问题有两个变量,即上述的 和

。(注意下层优化问题的解有可能是一个集合,所以是

)。注意标准形式的 BO 考虑了上层优化问题和下层优化问题额外的约束,即

和

。

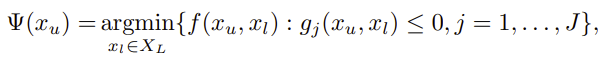

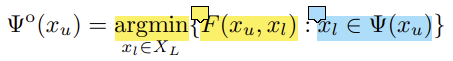

定义一个 set-valued mapping(即下层优化问题的解的集合):

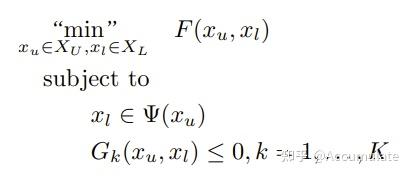

则二阶层优化问题可以表示为:

注意二阶层优化问题中的优化变量是 和

。

二阶层优化问题可根据下层优化问题选择的解对上层优化目标函数的影响,分为:乐观的二阶层优化和悲观的二阶层优化。

乐观的二阶层:

其中:

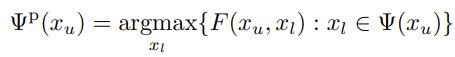

悲观的二阶层:

其中:

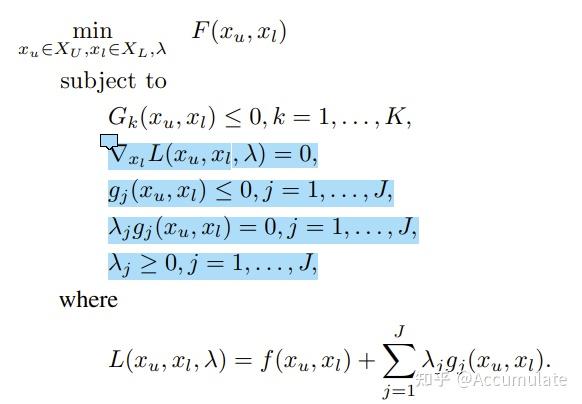

这类问题有许多求解方法,如可把下层优化问题替换成其的 Karush-Kuhn-Tucker (KKT) conditions,即如下所示:

标蓝的地方就是把原问题的下层优化问题替换成了其 KKT 条件。

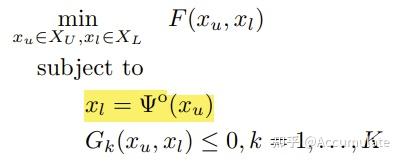

在机器学习中,许多文献会假设下层优化问题的目标函数是强凸函数且没有额外的约束,则此时下层优化问题的最优解只有一个,所以上述 可以替换成

。(机器学习中许多文献中考虑的都是最简单的 Bilevel Optimization Problem,即没有额外约束的二阶层优化问题)

更多关于 Bilevel Optimization 的介绍请关注于我们接收于人工智能顶会 ICLR 2023 的论文:Asynchronous Distributed Bilevel Optimization